Déontologie avocat et IA : le guide complet pour 2026 (CNB)

Introduction : Pourquoi la déontologie avocat-IA devient cruciale en 2026

Les obligations déontologiques des avocats face à l’intelligence artificielle constituent désormais un enjeu majeur pour la profession juridique. En 2026, l’entrée en vigueur progressive de l’AI Act européen et l’évolution du guide du Conseil National des Barreaux (CNB) créent un nouveau cadre de conformité que chaque cabinet doit impérativement maîtriser.

Pourtant, les chiffres révèlent une réalité préoccupante. 67% des cabinets de moins de 5 avocats déclarent manquer de compétences techniques pour évaluer la fiabilité des outils d’IA qu’ils emploient. Cette situation génère des risques déontologiques majeurs : violation du secret professionnel, non-conformité RGPD, hallucinations algorithmiques, ou encore dépendance cognitive excessive.

Synthèse des 7 piliers déontologiques IA pour 2026

Ce guide exhaustif détaille les 7 piliers fondamentaux de la déontologie avocat IA. Vous découvrirez les obligations précises, les sanctions encourues, les recommandations officielles du CNB et les bonnes pratiques pour intégrer sereinement l’IA dans votre cabinet. Ainsi, vous pourrez transformer votre pratique juridique tout en respectant les règles déontologiques les plus strictes.

🔹 Pourquoi la déontologie avocat-IA est-elle un enjeu majeur en 2026 ?

L’explosion de l’IA dans les cabinets d’avocats

L’intelligence artificielle générative bouleverse radicalement la pratique du droit. Des outils comme ChatGPT, Claude ou Copilot s’invitent désormais dans les cabinets pour analyser des dossiers, rédiger des actes ou effectuer des recherches juridiques. Cette révolution technologique promet efficacité et gain de temps considérables.

Entre 2023 et 2025, le nombre de cabinets utilisant l’IA a été multiplié par trois. Cette adoption massive s’explique par des gains de productivité spectaculaires. Par exemple, une analyse de contrat qui prenait 2 heures peut désormais être réalisée en 15 minutes avec un assistant IA juridique. Cependant, cette rapidité comporte des risques importants.

Beaucoup d’avocats utilisent ces outils sans formation préalable ni compréhension des dangers associés. Selon une étude de l’Observatoire des LegalTech, 67% des cabinets de moins de 5 avocats ne possèdent pas les compétences nécessaires pour évaluer la fiabilité des solutions qu’ils déploient. Pour mieux comprendre cette transformation, découvrez comment l’intelligence artificielle redéfinit le rôle de l’avocat moderne.

Les risques déontologiques méconnus

L’utilisation non encadrée de l’IA expose les avocats à trois catégories de risques majeurs. D’abord, les hallucinations algorithmiques : ces erreurs où l’IA invente des références juridiques totalement inexistantes. Une étude de Stanford révèle que les taux d’hallucinations atteignent 69% à 88% selon les modèles testés.

Définition – Hallucination algorithmique : Phénomène par lequel un système d’IA génère des informations factuellement incorrectes ou inventées, tout en les présentant avec assurance comme si elles étaient véridiques. En droit, cela peut inclure des citations de jurisprudence fictives, des articles de loi inexistants ou des interprétations juridiques erronées.

Ensuite, la violation du secret professionnel. Transmettre des données clients à une IA générative grand public peut constituer une rupture de confidentialité passible de sanctions disciplinaires et pénales. Le secret professionnel est absolu selon l’article 66-5 de la loi du 31 décembre 1971. Comme l’affirme le professeur Jean-Michel Bruguière, spécialiste du droit de la propriété intellectuelle : « Le secret professionnel de l’avocat n’est pas une simple obligation contractuelle, c’est un pilier fondamental de l’État de droit qui ne souffre aucune exception, même technologique. »

Enfin, la non-conformité RGPD. L’avocat est responsable de traitement des données personnelles. Utiliser une IA qui stocke ou réutilise ces données sans garanties suffisantes viole les obligations du Règlement Général sur la Protection des Données. Pour approfondir ce sujet essentiel, consultez notre guide détaillé sur comment l’IA respecte le RGPD dans les cabinets d’avocats.

L’évolution du cadre réglementaire

Le paysage normatif se structure rapidement avec des échéances précises. Le Règlement européen sur l’intelligence artificielle (AI Act), adopté en février 2024, entre en application progressive jusqu’en août 2026. Il impose des obligations strictes de transparence, documentation et évaluation des risques pour certains systèmes d’IA.

Parallèlement, le Conseil National des Barreaux a publié en septembre 2024 son premier guide pratique sur l’utilisation des systèmes d’IA générative. Ce document de référence propose des recommandations concrètes pour une utilisation responsable et conforme.

Le Règlement Intérieur National (RIN) demeure également applicable. Ses articles 1 à 3 rappellent les principes essentiels : dignité, conscience, indépendance, probité, humanité et secret professionnel. Source : RIN sur Légifrance

💡 À RETENIR : L’utilisation de l’IA par les avocats génère des risques déontologiques majeurs en 2026. Sans maîtrise des obligations de secret professionnel, de conformité RGPD et de vérification des contenus, les cabinets s’exposent à des sanctions disciplinaires et des dommages pour leurs clients. Le cadre réglementaire se renforce avec l’AI Act européen et les recommandations du guide CNB.

🔹 Obligation n°1 – Respecter le secret professionnel avec l’IA

Le secret professionnel, socle de la confiance avocat-client

Le secret professionnel constitue le socle de la relation de confiance entre l’avocat et son client. Son caractère absolu est reconnu par l’article 66-5 de la loi du 31 décembre 1971. De plus, le Règlement Intérieur National le rappelle à son article 2.1 comme étant « d’ordre public, général, absolu et illimité dans le temps ».

Ce secret couvre toutes les informations confiées par le client : entretiens, correspondances, identité, stratégie juridique, situation personnelle ou professionnelle. Il s’applique également au personnel du cabinet et à toute personne coopérant avec l’avocat dans son activité.

L’utilisation d’outils d’intelligence artificielle ne peut en aucun cas justifier une levée de ce secret. Au contraire, elle crée de nouveaux risques de violation. Comme le souligne le CNB dans son guide pratique : « Il convient de ne jamais utiliser dans l’IAG des données couvertes par le secret professionnel à des intelligences artificielles génératives, sous peine de sanctions ». Source : CNB – Guide IA septembre 2024

Les risques de fuite de données avec les IA génératives

Les IA génératives grand public comme ChatGPT dans sa version gratuite présentent des risques majeurs pour la confidentialité. Par défaut, certains modèles utilisent les conversations pour améliorer leurs algorithmes. Cela signifie que les données transmises peuvent être réutilisées, stockées sur des serveurs tiers, voire potentiellement exposées à d’autres utilisateurs.

Exemple concret : Un avocat utilise ChatGPT pour analyser un dossier de contentieux social en copiant-collant des informations nominatives. Même si le risque de fuite directe reste faible, le simple fait de transmettre ces informations à un tiers non habilité constitue une violation caractérisée du secret professionnel.

De plus, les conditions d’utilisation de ces outils évoluent régulièrement. Un service aujourd’hui confidentiel peut modifier sa politique demain. Par conséquent, l’avocat doit vérifier systématiquement les garanties contractuelles du fournisseur. Cette préoccupation rejoint l’objection courante : « Je crains que l’IA fasse des erreurs : juridiquement, je dois être sûr. » Rassurez-vous : l’IA ne décide pas à votre place. En effet, un cadre strict permet d’automatiser uniquement les tâches à faible risque avec des contrôles rigoureux (checklists, validations obligatoires, versioning).

La pseudonymisation : solution incontournable

Face à ces risques, la pseudonymisation s’impose comme la méthode recommandée par le CNB. Elle consiste à remplacer toutes les données permettant d’identifier une personne par des pseudonymes ou des données génériques.

Définition – Pseudonymisation : Traitement de données à caractère personnel de telle façon que les données ne puissent plus être attribuées à une personne concernée spécifique sans information supplémentaire. Contrairement à l’anonymisation, la pseudonymisation est réversible si l’on dispose de la table de correspondance.

Concrètement, avant de soumettre un document à une IA, l’avocat doit :

- Remplacer les noms par des appellations génériques (Monsieur X, Madame Y, Société A)

- Supprimer les adresses précises

- Anonymiser les numéros de dossier internes

- Retirer toute référence géographique permettant l’identification

Cette technique permet de bénéficier de l’assistance de l’IA sans compromettre la confidentialité. Cependant, elle exige du temps et de la rigueur. Pour les dossiers complexes, la pseudonymisation manuelle peut s’avérer fastidieuse. C’est pourquoi de nombreux cabinets adoptent des solutions d’automatisation sur mesure pour faciliter ce processus.

Quels outils IA respectent le secret professionnel ?

Tous les outils ne se valent pas en matière de confidentialité et de déontologie avocat IA. Les versions entreprise des IA génératives offrent généralement plus de garanties. Par exemple, ChatGPT Teams ou Claude Pro pour entreprises proposent :

- Aucune utilisation des données pour l’entraînement des modèles

- Stockage sécurisé et chiffré

- Conformité RGPD renforcée

- Possibilité de contrats de confidentialité

Les LegalTech spécialisées vont encore plus loin. Des solutions comme Doctrine, Lefebvre Dalloz ou certains outils développés par des éditeurs juridiques français intègrent nativement le respect du secret professionnel. Elles sont hébergées en Europe et leurs contrats prévoient des clauses strictes de confidentialité.

Avant de choisir un outil, l’avocat doit :

- Vérifier la localisation des serveurs (préférer l’Union européenne)

- Lire attentivement les conditions générales d’utilisation

- S’assurer de l’existence d’un DPA (Data Processing Agreement) conforme au RGPD

- Privilégier les solutions certifiées ou recommandées par la profession

💡 À RETENIR : Le secret professionnel reste absolu avec l’IA. Transmettre des données clients non pseudonymisées à une IA générative grand public constitue une violation sanctionnable. La pseudonymisation systématique (remplacement des identifiants) est obligatoire avant tout traitement. 83% des clients souhaitent être informés de l’usage de l’IA. Privilégiez les versions entreprise ou les LegalTech spécialisées offrant des garanties contractuelles de confidentialité.

🔹 Obligation n°2 – Garantir la conformité RGPD et protection des données

RGPD et IA : quelles obligations spécifiques ?

L’utilisation de l’intelligence artificielle par les avocats implique nécessairement le traitement de données personnelles. Cela place le cabinet sous le régime du Règlement Général sur la Protection des Données (RGPD) avec des obligations strictes et des sanctions potentiellement très lourdes.

Le RGPD s’applique dès lors qu’un traitement de données à caractère personnel est mis en œuvre. Lorsqu’un avocat utilise une IA générative pour analyser un dossier contenant des informations sur des personnes physiques, il réalise un traitement soumis au règlement.

Les principes fondamentaux du RGPD doivent être respectés :

- Licéité : le traitement doit reposer sur une base légale (consentement, intérêt légitime, obligation légale)

- Limitation des finalités : les données ne peuvent être utilisées que pour l’objectif défini

- Minimisation : seules les données strictement nécessaires doivent être traitées

- Exactitude : attention aux hallucinations de l’IA qui créent des données inexactes

- Limitation de la conservation : les données ne doivent pas être conservées au-delà du nécessaire

- Sécurité : des mesures techniques et organisationnelles appropriées doivent être mises en place

La CNIL a publié plusieurs guides sur l’IA et la protection des données. Elle rappelle que l’utilisation d’outils d’IA ne dispense pas du respect des obligations RGPD. Source : CNIL – Intelligence artificielle

Le rôle de responsable de traitement de l’avocat

L’avocat agit généralement comme responsable de traitement au sens du RGPD dans le cadre de la déontologie avocat IA. Cela signifie qu’il détermine les finalités et les moyens du traitement des données personnelles de ses clients. Cette qualité implique des obligations considérables.

Définition – Responsable de traitement : Personne physique ou morale, autorité publique, service ou organisme qui détermine les finalités et les moyens du traitement de données à caractère personnel. Le responsable de traitement est tenu de respecter l’ensemble des obligations du RGPD.

Il doit notamment :

- Tenir un registre des traitements documentant l’utilisation de l’IA

- Réaliser une analyse d’impact (AIPD) si l’outil présente des risques élevés

- Informer les personnes concernées de l’utilisation de leurs données

- Garantir l’exercice des droits (accès, rectification, effacement, opposition)

- Notifier les violations de données à la CNIL dans les 72 heures si nécessaire

Le non-respect de ces obligations expose le cabinet à des sanctions administratives pouvant atteindre 20 millions d’euros ou 4% du chiffre d’affaires annuel mondial. Même pour un petit cabinet, les amendes peuvent être proportionnées et significatives.

Face à l’objection « L’intégration va prendre trop de temps, je n’ai pas la bande passante », sachez que l’implémentation se fait en mode faible friction. En effet, on automatise d’abord ce qui existe déjà (modèles, arborescences, emails, CRM), sans changer vos habitudes. L’objectif : un premier flux utile rapidement, puis des itérations progressives.

Choisir des outils IA conformes au RGPD

Tous les outils d’IA générative ne présentent pas les mêmes garanties en matière de protection des données. Les versions grand public gratuites sont souvent problématiques. Par exemple, certains modèles stockent les conversations sur des serveurs américains sans garantie équivalente au RGPD.

Les critères de sélection d’un outil conforme incluent :

- Hébergement des données : préférer l’Union européenne

- Politique de confidentialité : transparence sur l’usage des données

- Certifications : ISO 27001, hébergement HDS pour les données de santé

- Non-réutilisation : engagement contractuel de ne pas entraîner les modèles sur vos données

- Durée de conservation : délai de suppression automatique des requêtes

Les LegalTech françaises et européennes offrent généralement de meilleures garanties que les solutions américaines. Elles sont souvent déjà conformes au RGPD par conception (Privacy by Design). Pour découvrir les solutions adaptées, consultez notre comparatif des meilleurs outils IA pour avocats en 2025.

Les clauses contractuelles à exiger des fournisseurs d’IA

Dans le cadre de la déontologie avocat IA, lorsqu’un avocat utilise un service d’IA externe, une relation de sous-traitance au sens du RGPD peut s’établir. Dans ce cas, un contrat de sous-traitance (DPA – Data Processing Agreement) doit obligatoirement être conclu.

Ce contrat doit préciser :

- L’objet, la durée, la nature et la finalité du traitement

- Les catégories de données traitées

- Les obligations du sous-traitant (sécurité, confidentialité, assistance)

- L’interdiction de sous-traiter sans autorisation écrite

- Les modalités de suppression ou restitution des données en fin de contrat

Sans ce contrat, le cabinet s’expose à un manquement RGPD caractérisé. Le CNB recommande dans son guide RGPD pour les avocats de systématiser ces clauses.

De plus, les clauses de limitation de responsabilité présentes dans les CGU des fournisseurs d’IA ne protègent pas l’avocat vis-à-vis de ses clients ou de la CNIL. En cas de violation de données, c’est bien le cabinet qui sera tenu responsable en premier lieu.

💡 À RETENIR : L’avocat est responsable de traitement RGPD lorsqu’il utilise l’IA avec des données clients. Il doit tenir un registre des traitements, réaliser une analyse d’impact si nécessaire et garantir l’exercice des droits. Les sanctions CNIL peuvent atteindre 20 millions d’euros ou 4% du CA. Exigez systématiquement un contrat de sous-traitance (DPA) avec les fournisseurs d’IA et privilégiez les solutions hébergées en UE avec engagement de non-réutilisation des données.

🔹 Obligation n°3 – Maintenir sa compétence et vigilance face aux hallucinations de l’IA

Qu’est-ce qu’une hallucination d’IA en droit ?

Les hallucinations de l’intelligence artificielle représentent l’un des risques les plus graves pour les avocats. Ce phénomène désigne la production par l’IA de contenus manifestement faux mais présentés avec assurance. En matière juridique, ces erreurs peuvent avoir des conséquences dramatiques sur les dossiers clients.

Une hallucination algorithmique survient lorsqu’un modèle d’IA génère des informations incorrectes tout en les présentant comme certaines. Dans le domaine juridique, cela peut prendre plusieurs formes :

- Invention de décisions de justice inexistantes avec numéros de référence crédibles

- Citation de textes de loi modifiés ou abrogés

- Attribution de jurisprudence à de mauvaises juridictions

- Création de précédents fictifs mais vraisemblables

- Distorsion de principes juridiques établis

Le danger réside dans la qualité apparente de ces productions. L’IA génère des textes parfaitement structurés, avec un vocabulaire juridique approprié et des références formellement correctes. Par conséquent, un avocat pressé ou peu vigilant peut facilement être trompé.

Techniquement, ces erreurs s’expliquent par le fonctionnement même des modèles de langage. Ces systèmes prédisent le mot suivant le plus probable statistiquement sans vérifier la véracité factuelle. Ils assemblent des éléments cohérents sans garantir leur exactitude. Comme l’explique le professeur Yann LeCun, pionnier de l’IA et professeur à l’Université de New York : « Les modèles de langage actuels n’ont aucune compréhension du monde réel. Ils produisent du texte statistiquement probable, pas nécessairement exact. »

Taux d’hallucinations des IA juridiques

Une étude majeure du Stanford RegLab et de l’Institute for Human-Centered AI a mesuré les taux d’hallucination de trois modèles populaires sur des requêtes juridiques spécifiques. Les résultats sont alarmants :

- GPT 3.5 : 69% d’hallucinations

- PaLM 2 : 72% d’hallucinations

- Llama 2 : 88% d’hallucinations

Ces chiffres concernent des IA généralistes. Même les IA juridiques spécialisées, entraînées sur des corpus de droit, présentent des taux d’erreur significatifs. L’étude démontre qu’aucun système actuel n’est totalement fiable pour la recherche juridique non supervisée.

Le problème persiste avec les systèmes RAG (Retrieval-Augmented Generation) qui combinent recherche documentaire et génération de texte. Bien que ces architectures réduisent les hallucinations, elles ne les éliminent pas complètement.

L’obligation de vérification systématique du contenu IA

Face à ces risques, l’avocat ne peut se contenter de reproduire le contenu généré par une IA. Le Conseil National des Barreaux est formel dans sa recommandation de janvier 2023 : « L’avocat demeure seul maître de son raisonnement juridique et ne saurait déléguer son obligation d’analyse critique à un outil technologique ».

Cette obligation découle directement du devoir de compétence prévu à l’article 21 du Code de déontologie. L’avocat doit se tenir à jour sur les technologies qu’il utilise mais aussi vérifier systématiquement toute information produite par ces outils.

Concrètement, par déontologie avocat IA, chaque référence juridique générée par l’IA doit être vérifiée :

- Consulter la décision citée sur les bases officielles (Légifrance, Dalloz, LexisNexis)

- Vérifier la date et l’autorité de la décision

- S’assurer que la citation est fidèle et non tronquée

- Confirmer que le principe dégagé correspond bien à la jurisprudence

Cette vérification peut sembler fastidieuse. Cependant, elle reste moins chronophage que la recherche manuelle initiale. L’IA peut être utilisée comme un outil de « débroussaillage » à condition d’exercer ensuite un contrôle humain rigoureux.

Face à l’objection « C’est trop complexe techniquement (API, sécurité, paramétrage…) », rassurez-vous : on privilégie des automatisations simples, traçables et réversibles. En effet, avec des règles claires, des modèles documentés et des validations humaines, vous gardez la main. De plus, la documentation, les logs et les procédures permettent de revenir en arrière si nécessaire.

Cas de jurisprudence aux USA : avocats sanctionnés pour fausses références

Plusieurs affaires illustrent les dangers des hallucinations non détectées. L’affaire Mata c. Avianca devant le tribunal fédéral de New York en mai 2023 est devenue emblématique. Un avocat a soumis un mémoire contenant six décisions de justice entièrement inventées par ChatGPT.

Les références semblaient crédibles : Varghese v. China Southern Airlines, Shaboon v. Egyptair, Petersen v. Iran Air. Lors de l’audience, l’avocat a admis avoir utilisé ChatGPT sans vérifier les sources. Le juge a infligé une sanction et contraint l’avocat à payer une amende.

Cette décision a créé un précédent international sur la responsabilité des avocats dans le contrôle des productions algorithmiques. Depuis, une base de données recense 137 affaires similaires dans le monde, dont deux au Canada.

Plus récemment, en mai 2025, le juge Joseph F. Kenkel de la Cour de justice de l’Ontario a ordonné à un avocat de redéposer ses arguments après avoir relevé de graves problèmes. Plusieurs affaires citées étaient fictives ou sans rapport avec le litige. Le juge a déclaré : « Les outils d’IA générative ne doivent pas être utilisés pour la recherche juridique dans ces conditions ».

Ces sanctions disciplinaires rappellent que la responsabilité de l’avocat demeure entière. L’article 184 du décret du 27 novembre 1991 prévoit des sanctions allant de l’avertissement à la radiation. L’usage négligent de l’IA peut caractériser un manquement aux obligations de compétence et de prudence.

💡 À RETENIR : Les hallucinations de l’IA juridique atteignent des taux de 69% à 88% selon Stanford. L’avocat reste seul responsable du contenu produit même avec assistance IA (obligation de compétence et prudence, RIN article 21). Vérifiez systématiquement chaque référence juridique sur les bases officielles. Plusieurs avocats ont été sanctionnés disciplinairement pour avoir soumis des décisions fictives générées par ChatGPT sans contrôle.

🔹 Obligation n°4 – Assurer la transparence et obtenir le consentement du client

L’obligation d’information du client sur l’usage de l’IA

La transparence constitue un principe cardinal de la déontologie des avocats. Avec l’arrivée de l’intelligence artificielle, cette exigence prend une dimension nouvelle. Les clients ont le droit de savoir quand et comment l’IA intervient dans le traitement de leur dossier.

Une étude de l’Université Paris-Saclay publiée en 2022 révèle un chiffre marquant : 83% des clients interrogés souhaitent être informés lorsque leur avocat utilise l’IA pour analyser leur dossier. Cette attente légitime pourrait se transformer en obligation déontologique formelle dès 2026.

Actuellement, aucun texte n’impose explicitement cette information. Cependant, plusieurs dispositions convergent vers cette exigence :

- L’article 10 du Règlement Intérieur National impose une information sincère et loyale dans toute communication

- L’article 1.3 du Code de déontologie consacre le principe de loyauté envers le client

- Le RGPD (article 13) exige d’informer les personnes sur les traitements automatisés de leurs données

Le CNB recommande dans son guide pratique de septembre 2024 de « faire preuve de transparence dans l’utilisation de l’IA ». Cette transparence protège à la fois le client et l’avocat en cas de litige ultérieur. Pour améliorer globalement vos échanges avec les clients, découvrez comment optimiser la relation client dans votre cabinet.

Consentement libre et éclairé : modalités pratiques

L’article 28 du Code de déontologie dispose que l’avocat doit obtenir le consentement du client au sujet du mandat. Cette disposition laisse entendre que l’utilisation de l’IA nécessite l’accord préalable du client sous la forme d’un consentement libre et éclairé.

Ce consentement doit être :

- Libre : le client peut refuser sans conséquence sur la relation professionnelle

- Éclairé : le client comprend ce qu’implique l’usage de l’IA

- Spécifique : le consentement porte sur l’utilisation d’IA, pas uniquement sur le mandat général

- Révocable : le client peut à tout moment demander l’arrêt de l’utilisation

Dans la pratique, plusieurs modalités existent pour recueillir ce consentement :

- Clause spécifique dans la convention d’honoraires

- Mention dans le contrat de mandat

- Information écrite lors de la première utilisation pour un dossier en cours

- Case à cocher sur un formulaire d’acceptation

L’information doit préciser :

- Quels types d’outils d’IA sont utilisés (générative, prédictive, etc.)

- Pour quelles tâches spécifiques (recherche, analyse, rédaction de projet)

- Quelles garanties de confidentialité sont mises en œuvre

- Que l’avocat conserve la maîtrise finale du raisonnement juridique

Traçabilité des traitements IA dans les dossiers

Au-delà de l’information initiale, l’avocat doit conserver une trace des utilisations de l’IA. Cette traçabilité répond à plusieurs objectifs :

- Documenter le respect des obligations déontologiques en cas de contrôle

- Permettre au client d’exercer ses droits RGPD (accès, rectification)

- Faciliter la défense de l’avocat en cas de mise en cause de sa responsabilité

- Assurer la continuité du dossier en cas de transmission à un confrère

Le registre des traitements RGPD peut inclure une rubrique « Utilisation de l’IA » mentionnant :

- Date de chaque utilisation

- Outil utilisé (nom et version)

- Nature de la tâche confiée à l’IA

- Vérifications effectuées sur le contenu produit

- Décisions finales prises par l’avocat

Cette documentation peut sembler bureaucratique. Pourtant, elle constitue un élément de preuve crucial en cas de contentieux. Elle démontre la diligence professionnelle et le respect des obligations de compétence.

Face à l’objection « Déontologie : secret professionnel, confidentialité… je ne peux pas risquer ça », sachez qu’on met la déontologie au centre. En effet, avec la minimisation des données, l’anonymisation/pseudonymisation quand possible, l’hébergement et les traitements cadrés, ainsi que des accès restreints, vous choisissez ce qui est traité, où, et avec quel niveau de confidentialité. L’IA n’est utilisée que là où c’est compatible avec votre cadre déontologique.

Clause contractuelle type pour honoraires avec IA

Pour sécuriser la relation avec le client, il est recommandé d’intégrer une clause spécifique dans la convention d’honoraires. Voici un exemple adapté :

« Dans le cadre de l’exécution de la présente mission, le Cabinet peut recourir à des outils d’intelligence artificielle pour certaines tâches auxiliaires (recherches documentaires, analyse de documents, projets de rédaction). Ces outils font l’objet de mesures strictes de confidentialité : pseudonymisation systématique des données clients, hébergement sécurisé en Union européenne, absence de réutilisation des données pour l’entraînement des modèles.

Le Cabinet conserve en toute hypothèse la maîtrise exclusive du raisonnement juridique et de la stratégie déployée. Chaque production assistée par IA fait l’objet d’une vérification et d’une validation par un avocat.

Le Client est informé qu’il peut s’opposer à l’utilisation de ces outils sans que cela n’affecte la qualité de la prestation, moyennant un ajustement éventuel des délais d’exécution et des honoraires. »

Cette clause remplit plusieurs fonctions :

- Elle informe le client de manière transparente

- Elle rassure sur les garanties de confidentialité

- Elle préserve la responsabilité et l’autonomie de l’avocat

- Elle permet au client d’exercer son droit d’opposition

💡 À RETENIR : L’article 28 du Code de déontologie impose d’obtenir le consentement du client pour l’utilisation de l’IA dans son dossier. Intégrez une clause spécifique dans votre convention d’honoraires précisant : types d’outils, tâches concernées, garanties de confidentialité, vérification humaine finale. Conservez une traçabilité des utilisations IA dans le registre RGPD. Le client peut refuser l’usage de l’IA sans conséquence sur la qualité de la prestation.

🔹 Obligation n°5 – Préserver son indépendance intellectuelle et esprit critique

Le risque de dépendance cognitive à l’IA

L’autonomie décisionnelle de l’avocat constitue un principe cardinal de la déontologie juridique. Avec l’avènement d’outils d’IA capables de générer des analyses juridiques complètes, se pose la question de la délégation cognitive et de ses limites éthiques.

Les IA génératives modernes impressionnent par leur capacité à produire des raisonnements juridiques structurés et convaincants. Un avocat peut obtenir en quelques secondes une analyse de 5 pages sur une problématique complexe. Cette facilité crée un risque insidieux : la tentation de s’en remettre à l’IA plutôt que de mener sa propre réflexion.

Cette dépendance cognitive présente plusieurs manifestations dangereuses. D’abord, l’effet d’ancrage : l’avocat qui lit d’abord l’analyse produite par l’IA aura tendance à valider cette vision plutôt qu’à explorer d’autres pistes. Ensuite, l’atrophie du raisonnement : à force de déléguer l’analyse préliminaire, les compétences juridiques propres peuvent s’éroder.

Certains jeunes avocats formés avec ces outils risquent de ne jamais développer pleinement leur capacité d’analyse autonome. Comme le souligne une étude du laboratoire de cyberjustice : « À plus long terme, on pourrait envisager le scénario d’un avocat qui refuse de recourir aux outils d’IA, ce qui constituerait un manquement à son obligation déontologique de compétence, à l’instar d’une incapacité d’effectuer des recherches dans des bases de données juridiques. »

Ce paradoxe illustre la ligne de crête sur laquelle évolue la profession : il faut maîtriser l’IA sans en devenir dépendant. Pour approfondir cette réflexion, consultez notre analyse sur l’intelligence artificielle avocat : 5 atouts clés et contraintes à connaître.

L’avocat maître de son raisonnement juridique

Le Conseil National des Barreaux a posé un principe clair dans sa recommandation de janvier 2023 : « L’avocat demeure seul maître de son raisonnement juridique et ne saurait déléguer son obligation d’analyse critique à un outil technologique ».

Cette position s’appuie sur les principes essentiels énoncés à l’article 1er du Règlement Intérieur National. L’avocat exerce ses fonctions avec conscience et indépendance. Ces valeurs impliquent une maîtrise personnelle du raisonnement juridique et une capacité à défendre une position en toute autonomie.

L’indépendance intellectuelle se distingue de l’indépendance vis-à-vis du client ou des tiers. Elle concerne la liberté de pensée de l’avocat face à tous les déterminismes, y compris technologiques. Un avocat qui reproduit mécaniquement les analyses d’une IA abdique cette indépendance.

Cela ne signifie pas rejeter l’IA. Au contraire, l’outil peut servir de stimulateur intellectuel : explorer des angles auxquels l’avocat n’aurait pas pensé, suggérer des précédents pertinents, confronter différentes interprétations. Mais le raisonnement final, la stratégie déployée, l’argumentation présentée doivent résulter d’une délibération personnelle.

Comment utiliser l’IA comme assistant, pas comme décideur

La clé réside dans le positionnement correct de l’intelligence artificielle : elle doit rester un outil au service de l’avocat, jamais un substitut. Plusieurs pratiques permettent de préserver cette juste distance.

Premier principe : toujours commencer par sa propre analyse. Avant de consulter l’IA, prenez le temps de formuler votre compréhension du problème juridique. Notez vos premières pistes de réflexion. Cette étape préserve votre autonomie intellectuelle et vous permet ensuite de comparer votre raisonnement à celui suggéré par l’IA.

Deuxième principe : utiliser l’IA en mode contradictoire. Plutôt que de demander « quelle est la solution juridique ? », formulez des prompts qui sollicitent plusieurs perspectives : « quels sont les arguments en faveur de la thèse X ? », puis « quels sont les arguments contre ? ». Cette approche dialectique stimule votre esprit critique.

Troisième principe : vérifier systématiquement les sources. Ne prenez jamais pour argent comptant une référence jurisprudentielle ou législative citée par l’IA. Consultez le texte original sur les bases officielles. Cette vérification constitue non seulement une obligation déontologique mais aussi un exercice intellectuel qui maintient vos compétences actives.

Quatrième principe : documenter votre processus décisionnel. Notez les éléments fournis par l’IA, vos vérifications, vos désaccords éventuels et votre raisonnement final. Cette traçabilité démontre votre autonomie intellectuelle en cas de contrôle.

Face à l’objection « Je ne fais pas confiance : qui a accès ? où vont mes données ? », sachez qu’on apporte de la traçabilité totale. En effet, avec des logs détaillés, vous savez qui a accès, quand, pourquoi. De plus, on applique le principe du moindre privilège et on sépare clairement les données sensibles des automatisations non sensibles.

Former les collaborateurs à l’esprit critique face aux IA

Les cabinets qui intègrent l’IA doivent impérativement former leurs équipes. Non seulement sur les aspects techniques, mais surtout sur la posture intellectuelle à adopter face à ces outils.

Une formation efficace devrait couvrir :

- Les limites techniques des IA (hallucinations, biais, absence de raisonnement causal)

- Les techniques de prompt engineering pour obtenir des résultats pertinents

- Les méthodes de vérification des contenus produits

- La déontologie et les obligations professionnelles

- Des études de cas d’erreurs causées par une confiance excessive en l’IA

Le CNB a lancé en partenariat avec Lefebvre Dalloz un parcours de formation gratuit sur la plateforme Skilia, accessible jusqu’en 2027. Plus de 10 000 avocats et élèves-avocats se sont déjà inscrits en deux mois.

Au-delà des formations techniques, il est essentiel de cultiver une culture de l’esprit critique au sein du cabinet. Organiser des débats contradictoires sur des dossiers, encourager la remise en question des analyses, valoriser la créativité juridique plutôt que la rapidité d’exécution.

Les associés et collaborateurs seniors ont un rôle de modèle. Si les jeunes avocats constatent que leurs aînés utilisent l’IA de manière réfléchie et critique, ils adopteront naturellement cette posture. À l’inverse, un usage mécanique et non supervisé de l’IA par les seniors légitimera les mauvaises pratiques.

💡 À RETENIR : L’autonomie décisionnelle de l’avocat est un principe cardinal. Le CNB rappelle que l’avocat doit rester « seul maître de son raisonnement juridique » et ne peut déléguer son analyse critique à l’IA. Utilisez l’IA comme assistant (exploration d’angles, suggestions), jamais comme décideur. Commencez toujours par votre propre analyse avant de consulter l’IA. Formez vos équipes à l’esprit critique : limites techniques, vérification systématique, déontologie. Le CNB propose une formation gratuite sur Skilia avec 10 000 inscrits en 2 mois.

🔹 Obligation n°6 – Respecter les obligations de l’AI Act européen (2026)

Qu’est-ce que l’AI Act et quand entre-t-il en vigueur ?

Le Règlement européen sur l’intelligence artificielle (AI Act), adopté en février 2024, constitue le premier cadre juridique mondial dédié à la régulation des systèmes d’IA. Son entrée en application progressive impose de nouvelles obligations aux utilisateurs et fournisseurs d’IA, y compris dans le secteur juridique.

L’AI Act (Règlement 2024/1689 du Parlement européen et du Conseil du 13 juin 2024) est entré en vigueur le 1er août 2024. Cependant, son application est progressive pour laisser aux acteurs le temps de se conformer. Source : EUR-Lex – AI Act

Définition – AI Act : Premier règlement européen contraignant encadrant le développement, la mise sur le marché et l’utilisation des systèmes d’intelligence artificielle dans l’Union européenne. Il adopte une approche fondée sur les risques, avec des obligations proportionnées à la dangerosité potentielle de chaque système.

Le calendrier d’application clé :

- 2 février 2025 : interdiction des pratiques d’IA inacceptables (manipulation cognitive, notation sociale)

- 2 août 2025 : obligations pour les modèles d’IA à usage général (transparence, documentation)

- 2 août 2026 : application complète du règlement, y compris pour les systèmes à haut risque

Cette approche graduée vise à permettre une transition maîtrisée. Néanmoins, les cabinets d’avocats doivent dès maintenant anticiper les exigences de 2026. Pour une vision complète de cette transformation, découvrez notre guide sur la transformation digitale des cabinets d’avocats en 2026.

Les systèmes IA à haut risque dans le secteur juridique

L’AI Act classe les systèmes d’IA selon leur niveau de risque. Les systèmes à haut risque font l’objet d’obligations renforcées. Dans le domaine juridique, plusieurs applications pourraient être concernées :

- Les systèmes d’aide à la décision judiciaire utilisés par les magistrats

- Les outils de justice prédictive évaluant l’issue probable d’un litige

- Les systèmes de scoring évaluant la fiabilité ou le risque associé à une personne

Pour les avocats, la question se pose : un outil d’IA juridique utilisé pour analyser un dossier constitue-t-il un système à haut risque ? La réponse dépend de plusieurs critères :

- L’outil produit-il une décision automatisée ayant des effets juridiques sur la personne ?

- L’outil est-il utilisé pour évaluer ou prédire le comportement d’une personne ?

- L’outil intervient-il dans l’administration de la justice ?

Dans la plupart des cas, les outils actuellement utilisés par les avocats ne seraient pas qualifiés de haut risque. En effet, ils fonctionnent comme assistants sans prise de décision automatisée. L’avocat conserve la maîtrise finale.

Cependant, cette frontière peut évoluer. Un outil d’IA qui, demain, proposerait automatiquement une stratégie contentieuse optimale basée sur l’analyse prédictive de milliers de décisions pourrait basculer dans la catégorie à haut risque.

Obligations de documentation et transparence

Même pour les systèmes d’IA ne relevant pas de la catégorie à haut risque, l’AI Act impose des obligations de transparence. L’article concernant les IA génératives prévoit notamment :

- Information des utilisateurs : les personnes doivent savoir qu’elles interagissent avec une IA

- Mention des contenus générés : obligation d’indiquer qu’un contenu a été produit par IA

- Documentation technique : les fournisseurs doivent publier des résumés sur les données d’entraînement

- Respect du droit d’auteur : conformité à la directive sur le droit d’auteur

Pour les avocats, cela signifie concrètement :

- Informer le client lorsqu’un document a été généré avec l’assistance de l’IA (rejoint l’obligation de transparence déontologique)

- Vérifier que les fournisseurs d’IA respectent leurs obligations de documentation

- S’assurer que les données d’entraînement des modèles utilisés n’enfreignent pas le droit d’auteur

Le CNB recommande dans son guide pratique de « privilégier l’utilisation d’une IA juridique pour générer un contenu juridique afin que l’apprentissage se fasse sur des ensembles de données diversifiés et représentatifs, garantissant ainsi une couverture complète et équilibrée des sujets juridiques ».

Sanctions financières en cas de non-conformité

L’AI Act prévoit un régime de sanctions particulièrement dissuasif. Les amendes peuvent atteindre :

- 35 millions d’euros ou 7% du CA mondial annuel pour les violations les plus graves (utilisation de systèmes interdits)

- 15 millions d’euros ou 3% du CA pour non-respect des obligations concernant les systèmes à haut risque

- 7,5 millions d’euros ou 1,5% du CA pour violation des obligations de transparence ou fourniture d’informations incorrectes

Ces montants concernent principalement les fournisseurs de systèmes d’IA. Néanmoins, les déployeurs (c’est-à-dire les utilisateurs professionnels comme les cabinets d’avocats) peuvent également être sanctionnés en cas de non-respect de leurs obligations.

Les autorités nationales compétentes sont chargées du contrôle. En France, la CNIL verra ses compétences étendues pour couvrir l’AI Act en plus du RGPD. Source : CNIL – Intelligence artificielle

Pour les cabinets, le risque financier reste limité compte tenu des montants en jeu. Cependant, une sanction publique aurait un impact réputationnel considérable. De plus, les violations de l’AI Act peuvent s’accompagner de violations du RGPD, multipliant les sanctions potentielles.

Calendrier AI Act : échéances 2025-2026

Les cabinets d’avocats doivent se préparer aux échéances clés :

Février 2025 : Vérifier que les outils utilisés ne relèvent pas des pratiques interdites (manipulation cognitive, notation sociale intrusive).

Août 2025 : S’assurer que les fournisseurs d’IA à usage général respectent leurs obligations de transparence et de documentation. Demander les informations sur les jeux de données d’entraînement.

Août 2026 : Mise en conformité totale. Documenter l’utilisation des systèmes d’IA, mettre en place des processus de vérification, informer les clients conformément aux exigences.

Le CNB travaille activement sur ces sujets et publiera des recommandations complémentaires. Une veille réglementaire s’impose pour rester à jour des évolutions.

💡 À RETENIR : L’AI Act européen s’applique progressivement jusqu’en août 2026. Les cabinets doivent informer les clients qu’un contenu a été généré par IA (obligation de transparence). Vérifiez que vos fournisseurs d’IA respectent leurs obligations de documentation et n’utilisent pas de données d’entraînement illicites. Les sanctions peuvent atteindre 35 millions d’euros ou 7% du CA mondial pour les violations graves. En France, la CNIL contrôlera l’application de l’AI Act. Échéance clé : août 2026 pour la mise en conformité totale.

🔹 Obligation n°7 – Appliquer les recommandations du Guide CNB 2024

Les 10 recommandations clés du Guide CNB

Le Conseil National des Barreaux a publié en septembre 2024 son premier guide pratique sur l’utilisation des systèmes d’intelligence artificielle générative. Ce document de référence propose des conseils concrets et des bonnes pratiques pour permettre aux avocats d’utiliser l’IA de manière responsable.

Le guide s’articule autour de plusieurs axes majeurs :

1. Ne jamais soumettre de données couvertes par le secret professionnel à une IA générative sans pseudonymisation préalable.

2. Privilégier les IA juridiques spécialisées plutôt que les modèles généralistes pour garantir une meilleure pertinence et limiter les hallucinations.

3. Vérifier systématiquement toute référence juridique, décision de justice ou texte législatif cité par l’IA.

4. Documenter l’utilisation de l’IA dans les dossiers pour assurer la traçabilité et démontrer le respect des obligations déontologiques.

5. Informer le client de l’utilisation d’outils d’IA et obtenir son consentement éclairé.

6. Conserver la maîtrise intellectuelle : l’IA doit rester un outil d’assistance, pas un décideur.

7. Se former aux techniques de prompt engineering pour obtenir des résultats pertinents et limiter les biais.

8. Choisir des fournisseurs conformes au RGPD avec garanties contractuelles de confidentialité et non-réutilisation des données.

9. Mettre en place une charte interne d’utilisation de l’IA au sein du cabinet pour sensibiliser tous les collaborateurs.

10. Effectuer une veille réglementaire sur l’évolution du cadre juridique (AI Act, recommandations CNB, jurisprudence).

Face à l’objection « Ça va me coûter trop cher pour un gain incertain », sachez qu’on ne vend pas un simple « outil IA ». En effet, on vend des heures récupérées et une réduction du risque d’erreur sur des tâches répétitives (tri, préparation de docs, pré-remplissage, checklists). On démarre par 1–2 processus qui impactent immédiatement la productivité.

Prompt engineering et bonnes pratiques de formulation

Le prompt engineering désigne l’art de formuler des requêtes optimisées pour obtenir des réponses de qualité et minimiser les erreurs de l’IA. Le CNB consacre une partie de son guide à cette compétence devenue essentielle.

Définition – Prompt engineering : Discipline consistant à concevoir, optimiser et structurer les instructions données à une IA générative pour maximiser la qualité, la précision et la pertinence des réponses produites. Cette pratique combine expertise du domaine, compréhension des modèles d’IA et techniques de formulation.

Les principes d’un bon prompt incluent :

- Contexte clair : préciser le domaine du droit, la juridiction, le type de document attendu

- Rôle défini : « Tu es un avocat spécialisé en droit social » aide l’IA à adopter le bon registre

- Instructions précises : détailler les attentes (longueur, format, style, éléments à inclure)

- Format structuré : demander des bullet points, un plan détaillé, des sections numérotées

- Limitations explicites : « ne cite que des décisions postérieures à 2020 », « utilise uniquement le droit français »

Exemple de prompt mal formulé : « Rédige un contrat de travail »

Exemple de prompt optimisé : « Tu es un avocat spécialisé en droit du travail. Rédige un projet de contrat de travail à durée indéterminée pour un cadre, statut non-cadre, dans une entreprise de 50 salariés en France. Le contrat doit inclure : durée de la période d’essai, rémunération fixe et variable, clause de mobilité, clause de confidentialité. Utilise un langage juridique précis et cite les dispositions légales applicables. Longueur : 3 à 4 pages. »

Le guide CNB insiste sur plusieurs points :

- Utiliser des prompts itératifs : affiner progressivement la requête en fonction des premiers résultats

- Segmenter les tâches complexes : décomposer une mission en plusieurs prompts successifs plutôt qu’une seule requête massive

- Vérifier la cohérence : confronter plusieurs générations de l’IA pour détecter les incohérences

- Documenter les prompts : conserver la trace des requêtes utilisées pour reproduire ou améliorer les résultats

Grille d’auto-évaluation pour choisir un outil IA juridique

Au-delà du guide pratique principal, le CNB a publié en juin 2025 une grille d’auto-évaluation permettant de comparer les différentes solutions d’IA juridiques disponibles sur le marché. Cet outil aide les avocats à choisir les logiciels adaptés à leurs besoins tout en respectant les règles professionnelles et déontologiques.

La grille évalue notamment :

- Conformité RGPD : hébergement des données, durée de conservation, engagements contractuels

- Sécurité et confidentialité : chiffrement, pseudonymisation, respect du secret professionnel

- Fonctionnalités juridiques : qualité de la base documentaire, mise à jour, spécialisation par domaine

- Transparence : documentation technique, explication des résultats, traçabilité

- Support et formation : accompagnement, tutoriels, service client

- Coût : tarification, rapport qualité-prix

Cette grille permet une comparaison objective des solutions. Le CNB ne recommande pas de solution spécifique mais fournit les critères d’évaluation. Chaque cabinet peut ainsi choisir l’outil le mieux adapté à sa pratique et à ses contraintes.

Face à l’objection « Ça ne marchera pas avec mon logiciel métier / mon fonctionnement », sachez qu’on s’adapte à votre stack existante. En effet, que ce soit email, Drive/SharePoint, Word, PDF, CRM, etc., on s’intègre. Et si un outil ne s’intègre pas directement, on automatise autour (exports, modèles, nomenclature, dépôt sécurisé). L’objectif est le résultat concret, pas de tout remplacer.

Formations obligatoires et sensibilisation des équipes

L’article 21 du Code de déontologie impose à l’avocat une obligation de se tenir à jour relativement aux technologies de l’information. Avec l’arrivée de l’IA, cette obligation prend une dimension nouvelle.

Le CNB a structuré une offre de formation complète :

- Parcours en ligne gratuit sur la plateforme Skilia (en partenariat avec Lefebvre Dalloz), accessible jusqu’en 2027

- Webinaires thématiques : IA et déontologie, IA et recherche juridique, IA et automatisation

- Guides pratiques téléchargeables : guide principal + fiches thématiques

- Synthèses des consultations : retours d’expérience et recommandations actualisées

Au-delà des formations officielles, chaque cabinet devrait organiser des sessions internes adaptées à sa pratique :

- Formation des collaborateurs aux outils choisis

- Ateliers de prompt engineering

- Études de cas d’erreurs à éviter

- Rappels déontologiques réguliers

La sensibilisation doit concerner tous les membres du cabinet, y compris le personnel administratif. Un assistant qui utilise ChatGPT pour rédiger un courrier client sans pseudonymisation crée un risque déontologique. D’où l’importance d’une charte interne claire sur l’usage de l’IA.

Cette charte devrait préciser :

- Les outils autorisés et interdits

- Les tâches pour lesquelles l’IA peut être utilisée

- Les obligations de pseudonymisation et vérification

- Le processus de validation par un avocat

- Les sanctions en cas de non-respect

Face à l’objection « J’ai peur de perdre la maîtrise : dépendance à un prestataire / lock-in », sachez qu’on vous livre un système documenté et transférable. En effet, avec les procédures, paramètres, modèles, plan de reprise, et possibilité d’hébergement/gestion par votre cabinet, l’objectif est votre autonomie, pas la dépendance.

💡 À RETENIR : Le Guide CNB publié en septembre 2024 propose 10 recommandations clés pour utiliser l’IA de manière responsable : pseudonymisation systématique, vérification des références, information du client, maîtrise intellectuelle. Le prompt engineering (formulation optimisée des requêtes) est essentiel pour limiter les hallucinations. Le CNB propose une grille d’auto-évaluation pour choisir les outils IA et une formation gratuite sur Skilia (10 000 inscrits). L’article 21 du Code déontologie impose une obligation de formation continue sur les technologies.

🔹 Checklist pratique : 12 actions pour une conformité déontologique IA

Voici une checklist concrète en 12 points pour vérifier et assurer la conformité de votre cabinet d’avocat aux obligations de déontologie avocat IA. À télécharger, imprimer et afficher dans votre cabinet pour une mise en conformité rapide.

Checklist technique (pseudonymisation, outils, RGPD)

☐ Action 1 : Mettre en place un processus systématique de pseudonymisation avant toute soumission de documents à une IA générative (remplacer noms, adresses, références identifiantes).

☐ Action 2 : Privilégier les versions entreprise des IA génératives (ChatGPT Teams, Claude Pro) ou les LegalTech françaises garantissant la non-réutilisation des données.

☐ Action 3 : Vérifier que vos outils IA sont hébergés en Union européenne et conformes au RGPD (certification ISO 27001, clause de confidentialité).

☐ Action 4 : Tenir un registre des traitements RGPD incluant une rubrique « Utilisation de l’IA » avec date, outil, tâche, vérifications effectuées.

Checklist contractuelle (clauses clients, fournisseurs)

☐ Action 5 : Intégrer une clause spécifique IA dans vos conventions d’honoraires informant le client de l’usage possible de l’IA et des garanties de confidentialité.

☐ Action 6 : Signer un contrat de sous-traitance (DPA) avec chaque fournisseur d’IA précisant les obligations de sécurité, confidentialité et suppression des données.

☐ Action 7 : Obtenir le consentement libre et éclairé du client pour l’utilisation de l’IA sur son dossier (case à cocher, clause contractuelle).

Checklist formation (sensibilisation équipe, veille réglementaire)

☐ Action 8 : Former tous les collaborateurs aux limites de l’IA (hallucinations, biais) et aux obligations de vérification systématique des contenus.

☐ Action 9 : Organiser des ateliers de prompt engineering pour apprendre à formuler des requêtes efficaces et limiter les erreurs.

☐ Action 10 : Créer une charte interne d’utilisation de l’IA précisant les outils autorisés, les tâches permises, les obligations de pseudonymisation et validation.

Checklist documentation (registre traitements, traçabilité)

☐ Action 11 : Vérifier systématiquement chaque référence juridique citée par l’IA sur les bases officielles (Légifrance, Dalloz, LexisNexis) avant utilisation.

☐ Action 12 : Conserver une trace documentée de chaque utilisation de l’IA : prompts utilisés, résultats obtenus, vérifications effectuées, décision finale de l’avocat.

💡 À RETENIR : Cette checklist en 12 actions couvre les 4 dimensions de la conformité déontologique IA : technique (pseudonymisation, outils RGPD), contractuelle (clauses clients/fournisseurs, DPA), formation (sensibilisation, prompt engineering, charte interne), documentation (registre traitements, traçabilité, vérification). Imprimez et affichez cette checklist dans votre cabinet. Effectuez un audit trimestriel pour vérifier le respect de ces 12 points. Optimum IA peut vous accompagner dans la mise en place de ces process.

🔹 FAQ – Vos questions sur la déontologie avocat et IA

Q1 : Un avocat peut-il utiliser ChatGPT pour rédiger des actes juridiques ?

Oui, mais sous conditions strictes. L’avocat peut utiliser ChatGPT ou d’autres IA génératives comme outil d’assistance pour ébaucher un projet d’acte. Cependant, il doit :

- Pseudonymiser toutes les données clients avant transmission

- Vérifier l’intégralité du contenu produit

- Adapter le document aux spécificités du dossier

- Conserver la maîtrise intellectuelle finale

L’IA ne doit jamais être utilisée en mode « copier-coller » sans analyse critique. Le CNB rappelle que l’avocat reste seul responsable du contenu juridique produit.

Q2 : Quelles sont les sanctions en cas de violation du secret professionnel avec l’IA ?

Les sanctions peuvent être disciplinaires, civiles et pénales :

- Sanctions disciplinaires : avertissement, blâme, interdiction temporaire d’exercer, radiation du barreau (article 184 du décret du 27 novembre 1991)

- Sanctions pénales : article 226-13 du Code pénal prévoit 1 an d’emprisonnement et 15 000€ d’amende pour violation du secret professionnel

- Responsabilité civile : dommages et intérêts envers le client pour préjudice subi

La transmission de données couvertes par le secret à une IA grand public sans pseudonymisation constitue une violation caractérisée.

Q3 : Dois-je informer systématiquement mon client de l’utilisation de l’IA ?

Oui, c’est fortement recommandé et pourrait devenir obligatoire en 2026. Selon une étude, 83% des clients souhaitent être informés. L’article 28 du Code de déontologie impose le consentement du client sur les modalités du mandat. La transparence protège à la fois le client et l’avocat.

Intégrez une clause spécifique dans votre convention d’honoraires précisant : types d’outils utilisés, tâches concernées, garanties de confidentialité, vérification humaine finale. Le client doit pouvoir refuser sans impact sur la qualité de la prestation.

Q4 : Comment pseudonymiser les données avant de les soumettre à une IA ?

La pseudonymisation consiste à remplacer les données identifiantes par des équivalents génériques :

- Remplacer « M. Jean Dupont » par « Monsieur X » ou « Le demandeur »

- Remplacer « Société ABC SARL » par « La société » ou « Société A »

- Supprimer les adresses précises (garder éventuellement la ville)

- Anonymiser les numéros de dossier internes

- Retirer les références permettant l’identification indirecte

Astuce pratique : Utilisez la fonction « Rechercher/Remplacer » de votre traitement de texte pour automatiser partiellement ce processus. Certaines LegalTech proposent des outils de pseudonymisation automatique.

Q5 : Quels outils IA sont conformes au RGPD et au secret professionnel ?

Privilégiez :

Versions entreprise : ChatGPT Teams, Claude Pro, Microsoft Copilot (avec contrat entreprise)

LegalTech françaises/européennes : Doctrine, Lefebvre Dalloz, Predictice, Case Law Analytics

Critères de sélection :

- Hébergement UE

- Engagement de non-réutilisation des données

- Contrat de sous-traitance (DPA)

- Certification ISO 27001

Évitez les versions gratuites grand public qui utilisent les conversations pour entraîner leurs modèles. Vérifiez toujours les conditions générales et la politique de confidentialité.

Q6 : L’AI Act s’applique-t-il aux petits cabinets d’avocats ?

Oui, l’AI Act s’applique à tous les utilisateurs professionnels d’IA dans l’UE, quelle que soit la taille du cabinet. Cependant, la plupart des outils utilisés par les avocats ne relèvent pas des catégories « à haut risque » définies par le règlement.

Les systèmes à haut risque concernent principalement :

- Les IA utilisées dans les décisions judiciaires (systèmes d’aide à la décision pour les juges)

- Les IA de recrutement ou d’évaluation des personnes

- Les systèmes biométriques

Pour les avocats, l’AI Act impose surtout :

- Transparence : informer quand une décision est prise ou assistée par IA

- Supervision humaine : l’avocat reste responsable des décisions finales

- Documentation : tracer l’utilisation de l’IA dans les dossiers sensibles

Les obligations sont proportionnées au risque. Un avocat utilisant ChatGPT pour résumer un jugement n’a pas les mêmes contraintes qu’un tribunal utilisant une IA prédictive pour évaluer la récidive.

Q7 : Puis-je utiliser l’IA pour rédiger des actes ou des conclusions ?

Oui, mais avec vigilance. L’IA peut être un excellent assistant de rédaction, mais l’avocat conserve l’entière responsabilité du contenu produit. Selon l’article 18 du RIN, l’avocat doit accomplir personnellement les actes de la profession.

Bonnes pratiques :

✅ Utiliser l’IA pour des brouillons, structures, ou reformulations

✅ Vérifier systématiquement : exactitude juridique, cohérence, pertinence

✅ Personnaliser : l’IA produit du générique, vous devez adapter au cas spécifique

✅ Relire avec attention : les hallucinations juridiques existent (faux articles, mauvaises références)

❌ Ne jamais copier-coller sans contrôle approfondi

❌ Ne pas déléguer la réflexion juridique à l’IA

Exemple d’hallucination : En 2023, un avocat américain a cité 6 décisions inventées par ChatGPT dans une requête judiciaire, entraînant des sanctions. La vérification reste impérative.

Q8 : Comment prouver ma diligence en cas de contrôle déontologique ?

En cas de contrôle par le Bâtonnier ou de réclamation client, vous devez pouvoir démontrer que vous avez respecté vos obligations déontologiques malgré l’utilisation d’IA.

Documentation à conserver :

- Contrats et CGU des outils IA utilisés (notamment les clauses de confidentialité)

- Clauses client : conventions d’honoraires mentionnant l’usage d’IA

- Procédures internes : guide d’utilisation de l’IA dans le cabinet, pseudonymisation, vérification

- Traces de vérification : annotations prouvant votre contrôle du contenu IA

- Formation : attestations de formation sur l’IA et la déontologie

Astuce : Créez une charte interne d’utilisation de l’IA validée par le cabinet, précisant les outils autorisés, les procédures de pseudonymisation, et les niveaux de validation requis selon le type de document.

Q9 : Quelles formations suivre pour utiliser l’IA en conformité déontologique ?

La formation continue est essentielle. Plusieurs organismes proposent des formations adaptées :

Formations déontologiques et juridiques :

- École de Formation des Barreaux (EFB) : modules sur IA et déontologie

- Centres régionaux de formation professionnelle des avocats (CRFPA)

- Conférences des Bâtonniers : webinaires et journées thématiques

- Université Paris-Dauphine, Sciences Po : programmes executive sur droit et IA

Formations techniques :

- Formations LegalTech : Doctrine, Lefebvre Dalloz proposent des certifications

- MOOC et formations en ligne : OpenClassrooms, Coursera (fondamentaux de l’IA)

- Ateliers pratiques : associations comme l’ADIJ (Association pour le Développement de l’Informatique Juridique)

Minimum recommandé : Au moins une formation par an combinant aspects techniques et déontologiques, pour un total de 7h (conformément aux obligations de formation continue des avocats).

Q10 : Comment gérer la responsabilité en cas d’erreur de l’IA ?

La responsabilité de l’avocat est toujours engagée en cas d’erreur, même si celle-ci provient d’un outil IA. Le principe est clair : l’IA est un outil, pas un co-auteur.

Fondements juridiques :

- Article 1240 du Code civil : responsabilité pour faute

- Article 66.5 de la loi du 31 décembre 1971 : responsabilité civile professionnelle obligatoire

- Jurisprudence constante : l’avocat répond de ses moyens auxiliaires

Conséquences pratiques :

- Vérifiez votre assurance responsabilité civile professionnelle (RCP) : couvre-t-elle l’utilisation d’IA ?

- Certains assureurs excluent ou limitent la couverture IA : négociez une extension spécifique

- Évaluez les risques par type d’acte : plus le document est stratégique (conclusions, contrat important), plus la vérification doit être rigoureuse

En cas de litige :

- Le client peut engager votre responsabilité disciplinaire (Ordre) ET civile (dommages-intérêts)

- Vous ne pourrez pas vous exonérer en invoquant « c’est la faute de l’IA »

- La charge de la preuve de votre diligence vous incombe

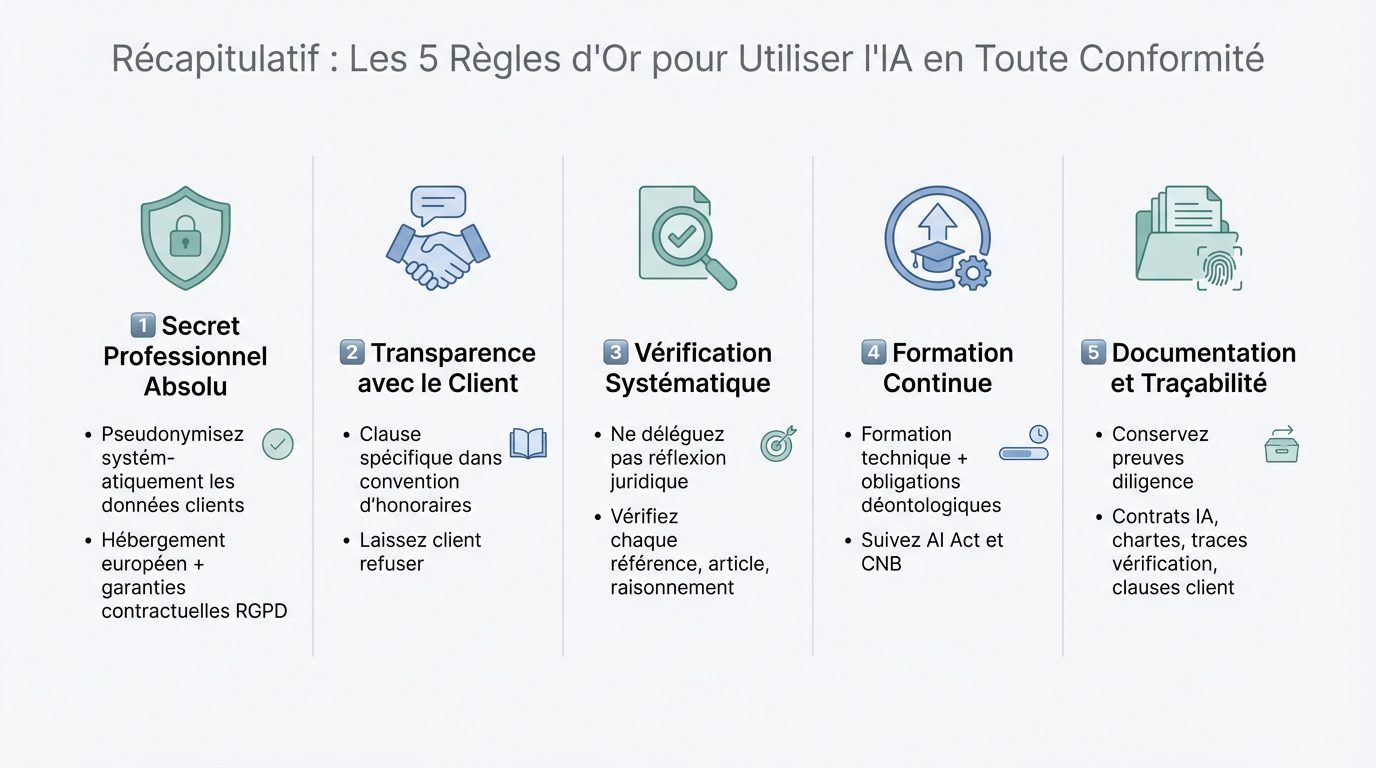

🎯 Récapitulatif : Les 5 Règles d’Or pour Utiliser l’IA en Toute Conformité

1️⃣ Secret Professionnel Absolu

Pseudonymisez systématiquement les données clients avant toute saisie dans une IA. Privilégiez les outils avec hébergement européen et garanties contractuelles RGPD.

2️⃣ Transparence avec le Client

Informez vos clients de l’utilisation d’IA dans une clause spécifique de votre convention d’honoraires. Laissez-leur le choix de refuser.

3️⃣ Vérification Systématique

Ne déléguez jamais votre réflexion juridique à l’IA. Vérifiez chaque référence, chaque article, chaque raisonnement produit par l’outil.

4️⃣ Formation Continue

Suivez au moins une formation par an combinant aspects techniques de l’IA et obligations déontologiques. Restez informé des évolutions réglementaires (AI Act, lignes directrices du CNB).

5️⃣ Documentation et Traçabilité

Conservez les preuves de votre diligence : contrats avec les fournisseurs IA, chartes internes, traces de vérification, clauses client.

📚 Ressources Officielles à Consulter

- Conseil National des Barreaux (CNB) : cnb.avocat.fr – Guides et recommandations sur l’IA

- CNIL : cnil.fr – Guides RGPD et outils IA

- Légifrance : Textes juridiques (RIN, Code de déontologie, AI Act)

- Ordre des avocats de votre barreau : Consultez votre Bâtonnier pour les recommandations locales

✅ Conclusion : L’IA, Allié Sous Contrôle

L’intelligence artificielle transforme profondément la profession d’avocat, offrant des gains de productivité considérables. Mais cette révolution technologique ne dispense en rien du respect scrupuleux des obligations déontologiques qui fondent la confiance entre l’avocat et son client.

Le secret professionnel, la compétence, la loyauté et l’indépendance demeurent les piliers intangibles de la profession. L’IA n’est qu’un outil : c’est l’avocat qui reste le garant de la qualité, de la confidentialité et de la pertinence juridique de son travail.

En adoptant une approche responsable, transparente et réfléchie, vous pouvez tirer pleinement parti de l’IA tout en préservant l’éthique et la déontologie qui font l’excellence de votre métier.

L’avenir appartient aux avocats qui sauront allier innovation technologique et rigueur déontologique.

🚀 Optimum IA : Votre Partenaire pour une Automatisation Déontologique et Sécurisée

Vous Voulez Automatiser Votre Cabinet en Toute Conformité ?

Chez Optimum IA, nous comprenons parfaitement les enjeux déontologiques auxquels vous faites face en tant qu’avocat. C’est pourquoi nous avons développé des solutions d’automatisation sur mesure, spécialement conçues pour respecter :

✅ Le secret professionnel et la confidentialité absolue

✅ Le RGPD avec hébergement des données en France/UE

✅ L’AI Act européen et toutes les réglementations en vigueur

✅ Le Code de déontologie des avocats (RIN)

🎯 Nos Services d’Automatisation pour Cabinets d’Avocats

1. Automatisation CRM Juridique

- Suivi client intelligent et sécurisé

- Gestion des interactions avec pseudonymisation automatique

- Respect total du secret professionnel

2. Gestion Automatisée des Emails

- Tri et catégorisation intelligente

- Réponses automatiques conformes aux obligations déontologiques

- Archivage sécurisé et traçable

3. Relation Client Optimisée

- Chatbots juridiques avec supervision humaine

- Prise de rendez-vous automatisée

- Communication transparente sur l’utilisation de l’IA

4. Gestion Documentaire Intelligente

- Recherche et indexation automatique

- Pseudonymisation des documents avant traitement IA

- Sauvegarde chiffrée et conforme RGPD

5. Organisation d’Agenda et Rappels

- Synchronisation multi-calendriers

- Rappels automatiques des deadlines

- Priorisation intelligente des tâches

6. Facturation et Suivi des Paiements

- Génération automatique des honoraires

- Relances intelligentes et personnalisées

- Tableaux de bord financiers en temps réel

7. Visibilité en Ligne et Prospection

- SEO juridique optimisé

- Génération de contenu conforme à la déontologie

- Automatisation LinkedIn pour avocats

8. Archivage et Conformité

- Conservation légale des documents

- Traçabilité complète des actions IA

- Audit déontologique intégré

🛡️ Notre Engagement : Sécurité et Conformité Maximales

→ Hébergement 100% français/européen : Vos données ne quittent jamais l’UE

→ Contrats de sous-traitance RGPD : DPA conformes avec tous nos partenaires

→ IA transparente : Toutes nos solutions respectent l’AI Act

→ Validation déontologique : Chartes d’utilisation conformes au RIN

→ Formation incluse : Accompagnement sur les bonnes pratiques déontologiques

→ Support dédié : Équipe juridique et technique à votre écoute

🎁 Pourquoi Choisir Optimum IA ?

✨ Solutions sur mesure : Pas de solution générique, chaque automatisation est adaptée à VOTRE cabinet et VOS besoins spécifiques

✨ Conformité garantie : Nous intégrons la déontologie dès la conception, pas après

✨ ROI prouvé : Nos clients gagnent en moyenne 15 heures par semaine et augmentent leur chiffre d’affaires de 30% en 6 mois

✨ Technologie française : Nous privilégions les IA européennes (Mistral AI) respectueuses de vos valeurs

✨ Accompagnement complet : De l’audit initial à la formation de vos équipes, nous sommes à vos côtés

📅 Réservez Votre Audit Gratuit Dès Aujourd’hui

Gagnez du temps, protégez vos clients, développez votre cabinet.

Bénéficiez d’un audit gratuit de 30 minutes pour identifier les automatisations prioritaires de votre cabinet, 100% conformes à la déontologie en cliquant ICI

Ou contactez-nous directement :

📧 Email : contact@optimumia.fr

🌐 Site web : www.optimumia.fr

📞 Téléphone : [Votre numéro]

⏰ Places limitées : Seulement 10 cabinets accompagnés par mois pour garantir un service d’excellence.

L’avenir de votre cabinet commence maintenant. Automatisez intelligemment, en toute sérénité pour répondre aux obligations déontologiques avocat IA.